सहित कई कंपनियाँ Microsoft і Facebook, और यहां तक कि दक्षिणी कैलिफोर्निया विश्वविद्यालय के शोधकर्ता भी डीपफेक का मुकाबला करने और येलो मीडिया और सामान्य रूप से गलत सूचना द्वारा उनके प्रसार को रोकने के लिए तकनीकों का विकास कर रहे हैं। हालांकि, वैज्ञानिकों का एक समूह अभी भी उन्हें बरगलाने में कामयाब रहा।

कैलिफोर्निया विश्वविद्यालय, सैन डिएगो में कंप्यूटर वैज्ञानिकों की एक टीम ने चेतावनी दी कि प्रत्येक वीडियो फ्रेम में "प्रतिस्पर्धी उदाहरण" नामक इनपुट डेटा डालकर मौजूदा डीपफेक डिटेक्शन सिस्टम को मूर्ख बनाना अभी भी संभव है। वैज्ञानिकों ने पिछले महीने ऑनलाइन आयोजित WACV 2021 कंप्यूटर विजन कॉन्फ्रेंस में अपने निष्कर्ष प्रस्तुत किए।

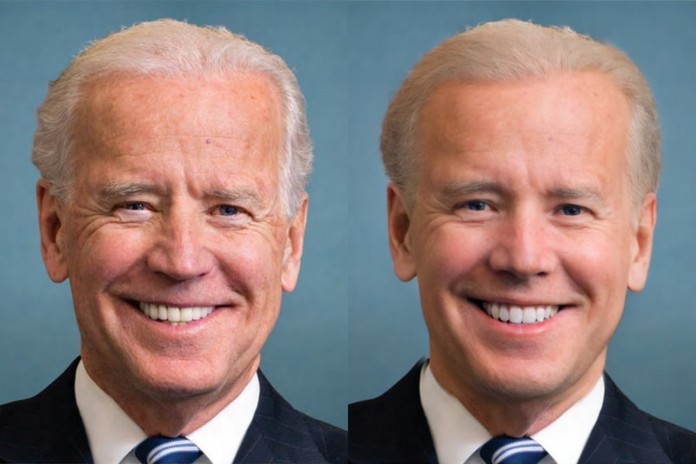

प्रतिस्पर्धी उदाहरण थोड़े बदले हुए इनपुट हैं जो कृत्रिम बुद्धिमत्ता प्रणाली, जैसे मशीन लर्निंग मॉडल, को गलतियाँ करने का कारण बनाते हैं। इसके अतिरिक्त, टीम ने दिखाया कि वीडियो को कंप्रेस करने के बाद भी हमला काम करता है। उपरोक्त वीडियो में, वैज्ञानिक दिखाते हैं कि एक्ससेप्शननेट, एक डीपफेक डिटेक्टर, उनके प्रतिस्पर्धी वीडियो को "वास्तविक" के रूप में लेबल करता है।

इनमें से अधिकांश डिटेक्टर एक वीडियो में चेहरों को ट्रैक करके और क्रॉप्ड फेस डेटा को विश्लेषण के लिए तंत्रिका नेटवर्क पर भेजकर काम करते हैं। तंत्रिका नेटवर्क तब इस डेटा का विश्लेषण करेगा और ऐसे तत्वों को खोजेगा जो आमतौर पर फ़्लिकरिंग जैसे डीपफेक में खराब रूप से पुन: प्रस्तुत किए जाते हैं।

प्रतिस्पर्धी उदाहरणों को सम्मिलित करके, शोधकर्ताओं ने पाया कि वे इन डीपफेक डिटेक्टरों को विश्वास दिला सकते हैं कि वीडियो वास्तविक थे।

वे कागज में कहते हैं कि "व्यवहार में इन डीपफेक डिटेक्टरों का उपयोग करने के लिए, एक अनुकूली विरोधी के खिलाफ उनका मूल्यांकन करना महत्वपूर्ण है जो इस सुरक्षा के बारे में जानते हैं और जानबूझकर इसे तोड़ने की कोशिश करते हैं। हम दिखाते हैं कि यदि हमलावर पूरी तरह से या यहां तक कि आंशिक रूप से डिटेक्टर के बारे में जागरूक है तो आधुनिक डीपफेक डिटेक्शन विधियों को आसानी से बायपास किया जा सकता है।"

जैसा कि इन वैज्ञानिकों ने दिखाया है, दुष्प्रचार से निपटने के लिए विकसित की जा रही स्वचालन प्रौद्योगिकियां अभी तक कार्य तक नहीं हो सकती हैं।

यह भी पढ़ें: